Pour distinguer le vrai du faux, l’analyse des incohérences physiques ne suffit plus. Face à des générateurs toujours plus performants, nous recommandons de coupler votre vigilance à des outils de détection dédiés, car la fiabilité humaine seule plafonne souvent autour de 75 %.

Vous est-il déjà arrivé d’hésiter devant un cliché viral en vous demandant s’il s’agissait d’une image générée par IA tant le réalisme est désormais trompeur ? En 2026, les générateurs d’images IA atteignent un niveau de qualité qui défie l’oeil humain. Nous avons identifié pour vous les indices anatomiques subtils et les failles logiques pour déjouer définitivement les pièges des deepfakes.

- Détecter une image IA à l’œil nu : les indices clés

- Indices avancés : arrière-plans, textures et cohérence globale

- Pourquoi cette vérification est devenue non-négociable

- Les meilleurs outils de détection automatique en 2026

- Méthode pratique : vérifier une image en 5 étapes

- Le piège de l’IA contre l’IA et l’avenir de la détection

- FAQ — Questions fréquentes

Détecter une image IA à l’œil nu : les indices clés

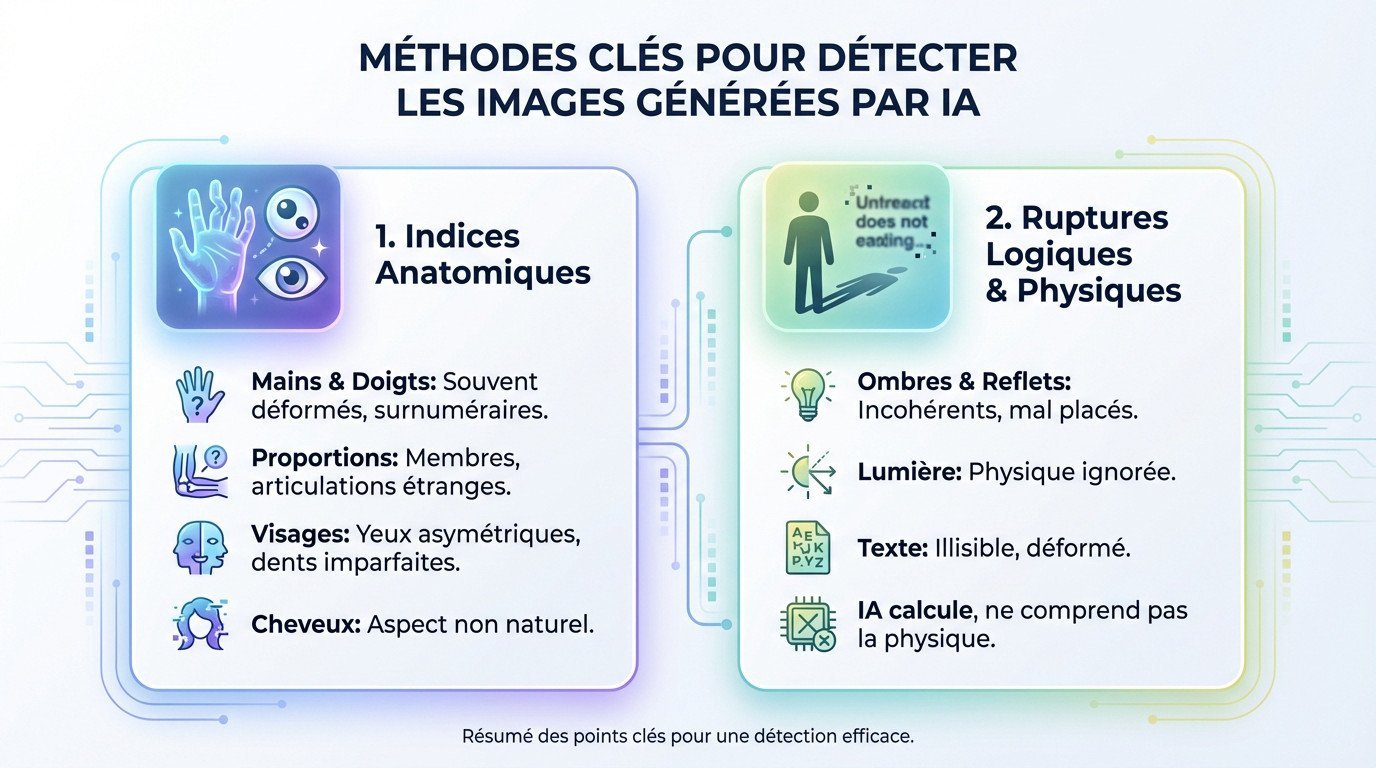

Les défauts anatomiques qui trahissent l’IA

Pour détecter une image générée par IA, le premier réflexe est d’observer les humains représentés. L’IA a encore du mal avec l’anatomie complexe. Les mains et les doigts sont souvent le point faible principal.

Cherchez des doigts surnuméraires, des membres aux proportions étranges ou des articulations mal formées. Les yeux peuvent être asymétriques, les dents mal alignées ou trop parfaites, et les cheveux peuvent manquer de naturel. Ces détails, bien que de plus en plus rares avec les nouveaux modèles, restent des indices précieux.

Quand la physique et la logique sont ignorées

Les ombres et les reflets sont un excellent indicateur. Une source de lumière devrait produire des ombres cohérentes pour tous les objets. Repérez une ombre qui part dans la mauvaise direction, ou l’absence totale de reflet là où il devrait y en avoir. Le texte illisible ou les écritures déformées sont un autre talon d’Achille des générateurs, même en 2026.

L’IA calcule, elle ne comprend pas intuitivement la physique. Elle peut dessiner une scène parfaite mais oublier comment la lumière interagit réellement avec les objets.

Indices avancés : arrière-plans, textures et cohérence globale

Les arrière-plans trop lisses ou trop chaotiques

Un signe souvent négligé : les arrière-plans générés par IA présentent fréquemment deux extrêmes. Soit un fond uniformisé et trop lisse, trop parfait pour être naturel. Soit un fond trop chargé avec des formes répétitives et des textures qui se dédoublent (appelées artefacts de tile).

Regardez attentivement les motifs dans les tissus, les briques, le feuillage. Si un motif se répète de manière trop régulière ou si les bords de certains objets présentent des éclats ou des flous incohérents, c’est généralement le signe d’une génération algorithmique.

Les bijoux, accessoires et logos : l’IA se trahit dans les détails

Les objets complexes comme les montres, les bijoux ou les logos sont particulièrement révélateurs. L’IA peine à reproduire fidèlement des formes symétriques avec des inscriptions précises. Un cadran de montre avec des chiffres illisibles, une bague dont la forme est asymétrique, un logo déformé : ces indices sont quasi infaillibles.

De même, les lunettes réfléchissent souvent des scènes qui ne correspondent pas à l’environnement visible dans l’image — une incohérence physique que l’IA ne corrige pas spontanément.

La méthodologie des métadonnées EXIF

Les vraies photos contiennent des métadonnées EXIF : modèle d’appareil, focale, date, coordonnées GPS. Les images générées par IA sont souvent dépourvues de ces métadonnées, ou ne contiennent que des données minimales sans référence à un appareil physique.

Pour lire les métadonnées d’une image, faites un clic droit > Propriétés > Détails sur Windows, ou utilisez des outils en ligne comme Jeffrey’s Exif Viewer. L’absence totale de métadonnées est un signal d’alerte, même si certaines plateformes les suppriment par défaut pour la vie privée.

Pourquoi cette vérification est devenue non-négociable

L’arme de la désinformation et de la fraude

Le déluge de visuels synthétiques offre un terrain de jeu rêvé aux manipulateurs. Les deepfakes et les fausses photos d’événements se propagent plus vite que la vérité sur les réseaux sociaux. C’est l’opinion publique qui trinque directement.

Côté escroquerie, des faux profils sur les applis de rencontre aux arnaques financières sophistiquées, ces images crédibles servent avant tout à briser la confiance. La détection est devenue une compétence numérique de base, au même titre que la vérification d’une source.

Les enjeux professionnels

Pour les professionnels, distinguer une image IA d’une image réelle dépasse la simple curiosité. C’est une question d’intégrité dans plusieurs domaines : journalisme (vérification avant publication), e-commerce (photos produits authentiques), juridique (recevabilité d’une preuve visuelle), éducation (originalité des travaux) et création artistique (protection du droit d’auteur).

Les meilleurs outils de détection automatique en 2026

Des solutions techniques existent pour dépasser les limites de l’oeil humain. Ces outils analysent les pixels eux-mêmes pour débusquer des motifs invisibles à l’œil nu, véritables signatures mathématiques des générateurs. Ils ont été entraînés sur des millions de visuels pour reconnaître la « patte graphique » de Midjourney, DALL-E, Stable Diffusion et consorts. Comme pour les outils vidéo IA, ces solutions évoluent très rapidement.

| Outil | Type d’analyse | Précision annoncée | Notre recommandation |

|---|---|---|---|

| Is It AI? | Pixels + artefacts | Très élevée | L’un des plus fiables, mis à jour fréquemment |

| AI or Not | Analyse pixels | Élevée | Gratuit, simple, bon pour un usage rapide |

| Hive Moderation | Multi-modèles | Très élevée | Recommandé pour usage professionnel |

| Sightengine | API développeurs | Modulable | Intégration en modération de contenu |

| Content at Scale | Texte + images | Bonne | Utile si vous combinez détection texte et image |

Aucun outil n’est infaillible — ils délivrent un score de confiance, pas une certitude absolue. Les faux positifs existent : une photo prise avec un appareil haut de gamme avec un lissage intense peut être signalée comme IA. Votre jugement reste indispensable. Les fonctionnalités de génération d’image comme Grok montrent à quel point les modèles deviennent photo-réalistes.

Méthode pratique : vérifier une image suspecte en 5 étapes

Plutôt que de se fier à un seul signal, la méthode la plus fiable est de combiner plusieurs niveaux d’analyse. Voici notre protocole en 5 étapes :

- Analyse anatomique : Zoomez sur les mains, les yeux, les dents et les contours. Cherchez les doigts en trop, les asymétries évidentes, les dents trop régulières.

- Vérification physique : Analysez les ombres, les reflets et la source de lumière. Sont-ils cohérents entre eux ? Le texte visible est-il lisible ?

- Inspection de l’arrière-plan : Cherchez les motifs répétitifs, les flous incohérents, les objets à demi formés sur les bords.

- Lecture des métadonnées EXIF : Vérifiez si l’image contient des informations d’appareil photo. L’absence totale est suspecte.

- Confirmation par outil dédié : Soumettez l’image à Is It AI? ou Hive Moderation pour un score de confiance. Croisez les résultats si l’enjeu est important.

Cette approche mixte — oeil critique + outil spécialisé — est aujourd’hui la plus efficace. Elle est directement applicable par tous, y compris sans compétences techniques. Si vous créez vous-même des visuels, consultez notre guide sur les meilleurs générateurs d’images IA pour comprendre ce que ces outils produisent.

Le piège de l’IA contre l’IA et l’avenir de la détection

Pourquoi votre chatbot n’est pas un détective

Demander à ChatGPT de trancher si une image est générée par IA est une fausse piste. Ces assistants sont des généralistes, pas des experts forensiques. Ils ne sont pas entraînés pour l’analyse des artefacts de génération et peuvent même échouer à reconnaître une image qu’ils auraient pu générer eux-mêmes.

Une course-poursuite technologique sans fin

C’est une bataille permanente. Chaque avancée dans la détection provoque une riposte des modèles génératifs. Les générateurs comme Midjourney V7 ou Adobe Firefly deviennent effroyablement réalistes, gommant les défauts d’hier. La clé est une approche mixte et mise à jour régulièrement.

La technologie du watermarking invisible (filigrane numérique intégré dans les pixels générés) est prometteuse : Google, OpenAI et Adobe développent des standards communs pour permettre une identification fiable. Cette technologie, couplée aux outils C2PA (Coalition for Content Provenance and Authenticity), devrait changer la donne dès 2026-2027. Suivez les actualités sur les modèles IA français et européens qui adhèrent à ces standards.

FAQ — Questions fréquentes sur la détection d’images IA

Comment savoir avec certitude si une image est générée par l’IA ?

Il n’existe pas de méthode 100 % infaillible. La meilleure approche combine l’analyse visuelle (mains, ombres, texte) et un outil de détection spécialisé (Is It AI?, Hive Moderation). En croisant les deux, vous atteignez une fiabilité supérieure à 90 % dans la plupart des cas.

Est-ce que ChatGPT peut détecter une image IA ?

Non, ChatGPT n’est pas conçu pour l’analyse forensique des images. Même s’il peut décrire une image, son jugement sur son origine est non fiable. Utilisez des outils dédiés comme Is It AI? ou Hive Moderation.

Est-ce que ChatGPT peut lui-même générer des images ?

Oui, via le modèle DALL-E 3 intégré. ChatGPT peut générer des visuels très réalistes à partir d’une description textuelle. Cette facilité d’accès multiplie le nombre d’images synthétiques en circulation et renforce la nécessité de vérifier l’authenticité des visuels.

Les images générées par IA ont-elles des droits d’auteur ?

En France et dans la plupart des pays, les images générées purement par IA sans intervention humaine substantielle ne sont pas protégées par le droit d’auteur. En revanche, si un humain guide significativement la création (prompt détaillé, retouches), la question est encore en débat juridique. Vérifiez toujours les CGU de l’outil génératif utilisé.

Quels sont les meilleurs outils gratuits pour détecter une image IA ?

AI or Not et Is It AI? proposent des versions gratuites accessibles sans inscription. Ils couvrent les principaux générateurs (Midjourney, Stable Diffusion, DALL-E). Pour un usage professionnel ou en volume, Hive Moderation et Sightengine offrent des API payantes plus précises.